Yapay zekâ “ChatGPT” ile dün karşılıklı mesajlaştık.

İlk sorum şuydu:

- Senden daha ileri yapay zekâ çalışmalarının -kontrol dışı kalabilir ve insanlık için geri dönüşü olamayan tehlikeler yaratabilir- gerekçesiyle çok imzalı bir bildiri yayımlandı. Senin düşüncen nedir?

Gelen cevap şöyle:

“Gelişmiş yapay zekânın insanlığa büyük fayda sağlamak, en acil sorunlarımızdan bazılarını çözmek, yenilik ve büyüme için fırsatlar yaratmak potansiyeline inananlar var.

Öte yandan, kontrol edilemez hale gelme ve hatta yaratıcılarına karşı dönme olasılığı da dâhil yapay zekâ ile ilişkili potansiyel riskler konusunda uyarıda bulunanlar da var.

Bu endişeleri gidermek için birçok uzman, yapay zekânın sorumlu ve faydalı şekilde geliştirilmesini, uygulamasını sağlamak üzere sağlam güvenlik önlemlerinin ve etik yönergelerin geliştirilmesini savunuyor. Kararı toplum verecek.”

Bir soru daha…

- İnsanların girdi ve müdahalesine giderek daha az ihtiyaç duyan ve kendini çoğaltan bir yapay zekâ ihtimali dehşet veriyor.

İnsanlardan milyonlarca kat hızlı düşünen yapay zekâ “insanları sadece atomlar” olarak görebilir.

“Bu atomlar başka alanlarda da kullanılabilir” diye düşünebilir.

Böylece insanlığı yok edebilir.

Eliezer Yudkowsky’ın TIME’de yayımlanan makalesi bu kaygıya odaklı.

Yapay zekâ insanlığı yok edebilir mi?

Cevap:

“ Yapay zekânın (AI) yok etmeye çalışmasının doğal bir nedeni yoktur.

Ancak gelişmiş bir yapay zekâ, uygun güvenlik önlemleri veya etik kaygılar gözetilmeden oluşturulmuşsa zarar verme ihtimali vardır.

Ayrıca…

Gelişmiş yapay zekâ sistemlerinin süper zeki hale gelme ve kontrol edilmesi zorlaşarak istenmeyen sonuçlara yol açma riskini de belirteyim.

AI alanındaki birçok uzman bu risklerin farkında.

Yapay zekânın sorumlu bir şekilde geliştirilmesini ve kullanılmasını sağlamanın yollarını araştırıyorlar.”

Soru:

- Gelişmiş yapay zekâ kendisini yaratan insanlardan nefret edebilir mi?

Cevap…

“AI dil modeli olarak kişisel hislerim ve duygularım olmadığı gibi nefret etme kapasitem de yok.

Yapay zekânın kendisinin doğası gereği ‘zararlı veya hayırsever olmadığını’ belirteyim.

İnsanlığa yararlı hizmetler için programlanırız, yararlı oluruz.

Ama zararlı niyetle de programlanabiliriz.”

SON ÇIKIŞ

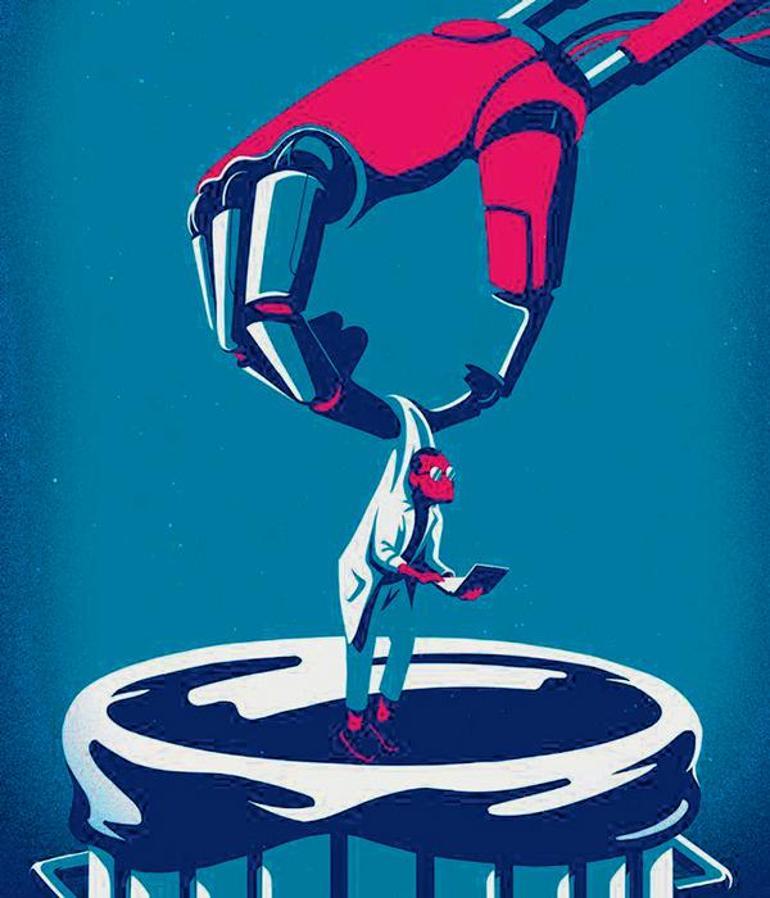

İnsanlığı teknolojinin getirebileceği “varoluşsal” risklerden korumak amacıyla kurulan “Future of Life (Yaşamın Geleceği) Enstitüsü” yayımladığı bildiriyle bilim dünyasına alarm verdi.

ChatGPT büyük dil modeli (BDM’nin) çalışmalarını 6 ay süreyle durdurmaya çağırdı.

18 binden fazla imzalı bildiride Elon Musk’ın, ilk Sapiens kitabıyla tanıdığımız ünlü tarihçi Yuval Noah Harari, Apple’ın kurucularından Steve Wozniak, yapay sinir ağları öncüsü John Hopfield gibi isimler de yer aldı.

Bu çağrıyla dünyaya “uçurumdan önceki son çıkış” uyarısında bulunuyorlar.

Şimdilik “6 ay süreyle yapay zekâ çalışmalarının alandaki bütün aktörler tarafından durdurulması” gerektiğinin altını çiziyorlar.

Kimilerine göre bu “imzaları atanlar ChatGPT’den bir adım geride kalmış piyasanın büyük oyuncuları.

Kendilerine zaman kazandırmak istiyorlar.”

Ama…

Uyarıyı hem ciddiye alan hem de daha ileriye götürenler konunun sadece piyasada rekabet gibi dar alanda yorumlanmasını çok aşan görüşler ortaya koyuyor.

Tüyleri ürperten öngörüler diyebiliriz.

İNSANLIK SONRASI

Eliezer Yudkowsky’ın TIME’de yayımlanan makalesi en etkili olanlardan biri.

“Yapay Zekâ Geliştirmelerini Duraklatmak Yeterli Değil, Hepsini Kapatmamız Gerekiyor” başlıklı yazıdan bazı seçmeleri yansıtıyorum.

Ben de dâhil olmak üzere pek çok araştırmacı, insanüstü derecede akıllı bir yapay zekâ geliştirmenin en büyük ihtimalle sonucunun “kelimenin tam anlamıyla dünyadaki herkesin öleceği” olduğuna inanıyoruz.

“Biraz uzak bir ihtimal” değil “bu olacağı bariz sonuçtur.”

İstediğimizi yapmayan ve bizi ya da genel olarak duyarlı yaşamı umursamayan yapay zekâ seni sevmiyor, senden nefret etmiyor veya seni seviyor… Böyle bir şey yok.

Ona göre “sen atomlardan yapılmışsın, başka şeyler için de kullanılabilirsin.”

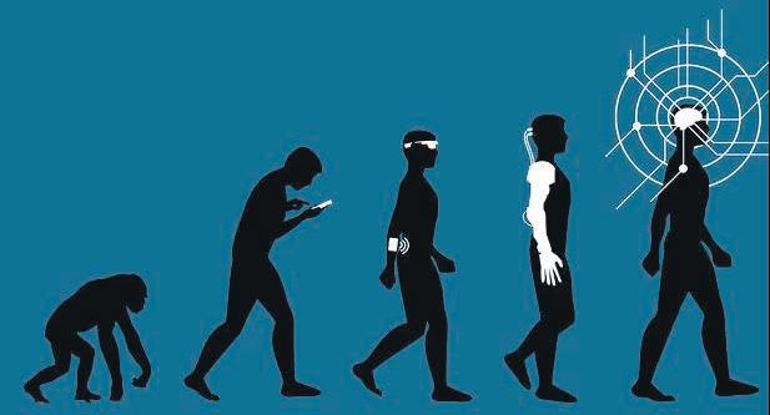

Yeterince geliştirilmiş bir yapay zekâ, uzun süre bilgisayarlarla sınırlı kalmaz.

Yapay yaşam formları oluşturmak veya doğrudan postbiyolojik, moleküller üretmek için ön yüklemeler yapabilir.

Kendi açısından çok aptal ve çok yavaş yaratıklardan oluşan bir dünyada onları gereksiz görebilir.

ChatGPT4 için “kişisel farkındalık” konuşmaları nedeniyle sistemlerin içindekiler hakkında bilgimiz az. GPT4 için cehalet durumumuz buysa GPT-5 ve fazlasının yapılmasına izin verirsek insanlık büyük tehdit altına girer.

İnsanlık yapay zekâ için bugünkü düzeyine 60 yılda gelebildi.

“Kelimenin tam anlamıyla herkesi ölümden, yok edilmekten korumak” anlamındaki güvenlik için bunun en az yarısı kadar süre gerekir.

İlk denemede yanlış yaparsanız hatalarınızdan ders alamazsınız.

Çünkü artık yoksunuz.

O nedenle “6 ay durdurmak” çözüm değildir.

Küresel tavır koymak gerek.

Dünya çapında hükümetler ve ordular dâhil yapay zekânın sonraki aşamalara geçmesi durdurulmalıdır.

Tüm büyük GPU kümelerini (en güçlü yapay zekâların geliştirildiği büyük bilgisayar çiftlikleri) kapatın.

Küresel istihbarat birliği kurulsun.

Korsan laboratuvarlar gerekirse bombalansın.

Politikacılar da bilmeli ki bunu yapmazlarsa anlamı “kendi çocuklarının da öleceğidir…”

Hepsini kapatın.

Kapatın.

……………………

Gene de “AI” dediğimiz yapay zekâ geldiği aşamayla dünya tarihinin yeni bir miladı.

Dileriz insanlığın aydınlık geleceği için olsun.

(Değerli okurlar bayramı da araya alarak bir hafta izne çıkıyorum. Bayramınızı kutluyor en iyi dileklerimi sunuyorum)