ChatGPT’ye çiçeği için sordu, aldığı cevapla şoke oldu! 'En korkutucu şey'

05.05.2025 - 14:54 | Son Güncellenme:

milliyet.com.tr

ChatGPT’ye çiçeğinin sararan yapraklarıyla ilgili soru soran genç kadın, karşılığında başka bir kişiye ait özel bilgilerle dolu yanıt aldı. Sosyal medyada infial yaratan olay, yapay zekânın güvenliği ve veri gizliliği konusundaki endişeleri yeniden gündeme taşıdı.

Milliyet.com.tr ÖZEL - Ghibli tarzı görsellerle kısa süre önce büyük ilgi gören yapay zekâ ChatGPT, bu sefer hatalı çıktılar nedeniyle gündeme geldi. Bir kullanıcı, çiçeğindeki sorunu ChatGPT'ye sorduğunda beklenmedik bir yanıtla karşılaştı. Kullanıcının aldığı şok edici cevap, aslında başka bir kişiye ait kişisel verilerdi.

'EN KORKUTUCU ŞEY'

Bu durumu yapay zekânın yaptığı "en korkutucu şey" olarak nitelendiren Pruthvi Mehta adlı genç kadın, LinkedIn'deki paylaşımında, "Sundari'min (tavus kuşu çiçeği) birkaç fotoğrafını ChatGPT'ye yükledim. Amacım sadece yapraklarının neden sarardığını anlamaktı" dedi. Ancak ChatGPT'nin çiçek bakımı konusunda tavsiye vermek yerine kendisine başka birinin kişisel bilgilerini sunduğunu belirtti.

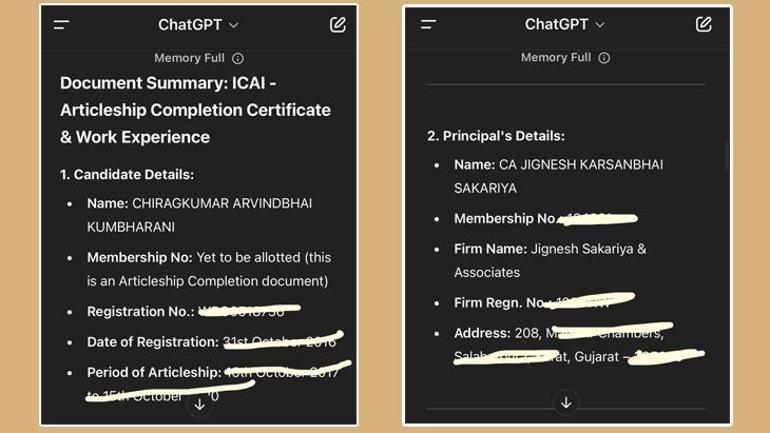

Pruthvi Mehta, yanıtta "Bay Chirag'ın tam özgeçmişi, CA öğrenci kayıt numarası, müdürünün adı ve ICAI üyelik numarası yer alıyordu. Üstelik bu bilgilere kendinden emin bir şekilde 'Stratejik Yönetim' notları adını vermişti" ifadelerini kullandı.

Yaşadığı olumsuz deneyimi anlatan Yeminli Mali Müşavir Pruthvi Mehta, paylaşımında, "Sadece ölmek üzere olan bir yaprağı kurtarmak istiyordum. Yanlışlıkla birinin tüm kariyerini indirmek değil" dedi.

'İNANCIMIZI HÂLÂ KORUYABİLİR MİYİZ?'

Yapay zekâ teknolojisinin aşırı kullanımını sorgulayan bu paylaşım, sosyal medyada 900'den fazla beğeni ve çok sayıda yorum aldı. Ghibli çizimlerinde yaşanan aşırı kullanıma bir tepki olarak ChatGPT'nin böyle bir hata yaptığını öne süren Metha, "Yapay zekâya olan inancımızı hâlâ koruyabilir miyiz?" sorusunu yöneltti.

İnternet kullanıcılarından gelen yoğun tepkiler üzerine bir kullanıcı, "Verilerin uydurma ve yanlış olduğundan eminim!" yorumunu yaptı. Başka bir kullanıcı ise, "Bu çok şaşırtıcı çünkü soruda tamamen farklı bir şey isteniyor" şeklinde konuştu.

Üçüncü bir kullanıcı, "Acaba bunlar gerçekten birinin bilgileri mi yoksa sadece uydurma mı? Yine de biraz endişe verici görünüyor. Ancak daha çok algoritmalarındaki bir hataya benziyor" ifadelerini kullandı. Dördüncü bir kullanıcı ise, "Tüm sohbet geçmişinin bununla bir bağlantısı olmadığı sürece bunun mümkün olduğunu düşünmüyorum" şeklinde yanıt verdi.